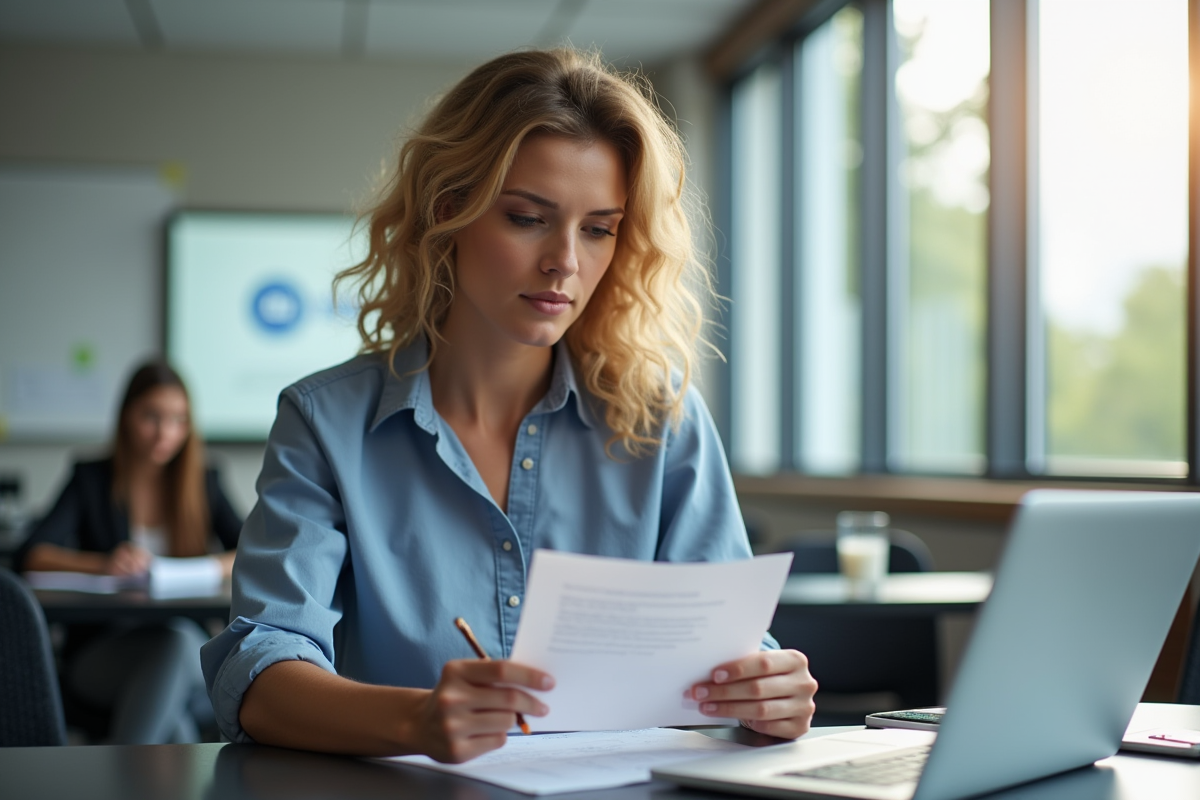

Un écran qui ne clignote jamais, des phrases sans accrocs, une rédaction qui semble venir d’un autre monde : voilà le nouveau visage des devoirs scolaires. ChatGPT a changé la donne. Mais les profs, eux, ne sont pas restés les bras croisés.

Un phénomène en pleine expansion : l’usage de ChatGPT par les étudiants

L’intelligence artificielle a fait une entrée fracassante dans l’éducation. En 2023, ChatGPT, mis au point par OpenAI, s’est invité dans les classes et les amphis, du collège à l’université. Près d’un tiers des lycéens français utilisent déjà des outils d’IA pour leurs devoirs, selon le ministère de l’Éducation nationale. Ce n’est plus une marginalité : l’IA s’installe aussi bien pour le soutien scolaire que pour les dissertations ou les rapports universitaires.

A voir aussi : Détecter ChatGPT : astuces pour rester incognito en ligne

Face à cette vague, certains établissements ont réagi sans attendre. Sciences Po Paris a décrété l’interdiction formelle de ChatGPT pour l’ensemble de ses étudiants. À l’université de Strasbourg, des sanctions sont tombées après des cas avérés de triche assistée par IA. Les directions d’établissements tentent de freiner une pratique qui se généralise à toute allure. Pap Ndiaye, alors ministre de l’Éducation nationale, a pris position pour un encadrement strict de l’intelligence artificielle dans les écoles et universités françaises.

Cette transformation bouscule les habitudes des enseignants. L’équité entre élèves devient un défi, surtout quand ChatGPT permet de livrer des textes structurés, impeccables et rapides. Comment continuer à cultiver la pensée critique et la singularité de chaque élève, quand déléguer à la machine devient si simple ? La détection de l’IA s’impose alors comme une nouvelle frontière du métier d’enseignant, entre technique, éthique et pragmatisme.

A lire aussi : L'art et la culture à l'ère du numérique

Quels indices permettent de soupçonner un texte généré par une intelligence artificielle ?

Face à l’arrivée massive de textes produits par ChatGPT, les enseignants développent de nouveaux réflexes. Certains signaux ne trompent pas. D’abord, la perfection grammaticale saute aux yeux : une syntaxe sans bavure, un lexique abondant mais impersonnel, aucune de ces fautes ou hésitations qui ponctuent habituellement les copies d’élèves. Même les meilleurs n’atteignent pas une telle régularité.

Autre indice : le style d’écriture uniforme et sans aspérité. L’IA a du mal à reproduire les hésitations, les formulations inattendues, ou les maladresses qui font la patte d’un auteur humain. Les textes déroulent leur logique sans accroc, parfois trop sagement. Les références citées peuvent être vagues, invérifiables, voire inventées, un détail qui alerte souvent les enseignants. Ceux-ci comparent alors avec ce qu’ils connaissent de chaque élève : ses tics de langage, ses points faibles récurrents, ses progrès attendus d’un devoir à l’autre.

Voici quelques signes qui reviennent souvent dans les observations :

- Absence d’erreurs personnelles : pas d’accord oublié, pas de maladresse dans la tournure.

- Argumentation trop fluide : tout coule, sans prise de risque ni exemple personnel.

- Références ou citations douteuses : impossibles à vérifier, ou sorties de nulle part.

Marie L., professeure de lettres, parle d’une « voix sans corps » : un texte parfaitement déroulé, mais privé de cette touche d’incertitude ou d’authenticité qui signe le travail d’un élève. Pour lever le doute, certains enseignants n’hésitent pas à organiser une rapide discussion orale ou à proposer des exercices inédits, impossibles à générer avec une IA.

Panorama des outils et techniques de détection à la disposition des enseignants

La progression de l’intelligence artificielle dans l’éducation a fait apparaître de nombreux outils spécialisés. Devant l’imagination des élèves, les enseignants s’équipent de détecteurs d’IA tels que Turnitin, Originality.ai, Winston AI, GPTZero ou DetectGPT. Ces logiciels passent les textes au crible, traquent la signature des générateurs comme ChatGPT, examinent la structure et les champs lexicaux. Mais rien n’est garanti : certains écrits passent à travers, et des outils comme HIX Bypass s’emploient à déjouer la surveillance automatisée.

Les établissements s’organisent : ils intègrent ces outils directement dans leurs plateformes pédagogiques (Canvas, Moodle, Google Classroom), ce qui permet de repérer plus vite les devoirs suspects. À ce filet technologique s’ajoute l’expertise humaine. L’analyse du style, l’entretien individuel, la vérification précise des sources citées restent des moyens de contrôle majeurs. Comme le rappelle Marie L., l’œil du prof et l’algorithme se complètent.

La fiabilité de ces outils fait débat. Faux positifs, évolutions rapides des techniques pour brouiller les pistes : la réalité évolue sans cesse, et les marges d’erreur sont bien réelles.

Voici les principales approches utilisées aujourd’hui :

- Outils automatisés : Turnitin, GPTZero, DetectGPT

- Vérification humaine : lecture attentive, questions ciblées posées à l’élève

- Intégration dans les environnements numériques : plateformes éducatives connectées

Désormais, la détection se joue sur deux tableaux : l’humain garde un rôle central, tout en s’appuyant sur la puissance de la machine.

Gérer sereinement l’intégration de l’IA dans la pratique pédagogique

L’irruption de l’intelligence artificielle comme ChatGPT dans l’éducation oblige à repenser les méthodes et à ouvrir le débat. Les enseignants modifient leurs modes d’évaluation, tout en posant les bases d’un dialogue sur l’éthique. L’objectif ne se limite plus à repérer l’usage de l’IA : il s’agit aussi d’accompagner les élèves pour qu’ils comprennent les enjeux et respectent un cadre clair. Les chiffres parlent : près d’un lycéen sur trois a déjà utilisé l’IA pour rédiger un devoir, avec des réponses variées selon les établissements, de l’interdiction stricte à la sanction, comme à Sciences Po Paris ou à l’université de Strasbourg.

Au quotidien, les enseignants rappellent l’importance de développer la pensée critique. Il ne s’agit pas de bannir l’automatisation, mais de veiller à ce qu’elle ne remplace pas l’effort intellectuel. En classe, la sensibilisation à un usage raisonné de ChatGPT devient incontournable. Tout l’enjeu : trouver la juste place entre innovation technologique et exigences pédagogiques.

Pour accompagner ce virage, plusieurs axes de travail se dessinent :

- Sensibiliser aux enjeux éthiques liés à l’IA

- Faire évoluer les modalités d’évaluation

- Favoriser l’apprentissage actif et l’autonomie

Certains enseignants testent l’usage de ChatGPT comme assistant, surtout en informatique, tout en restant vigilants sur l’apprentissage du raisonnement. L’école, plus que jamais, doit rester un lieu d’analyse, de transmission et d’émancipation, au-delà du simple recours à l’intelligence artificielle.

Demain, la frontière entre l’humain et la machine dans l’éducation ne tiendra pas à un logiciel ou à une règle, mais à la capacité de chaque élève à donner sa voix, unique, au savoir qu’il construit.